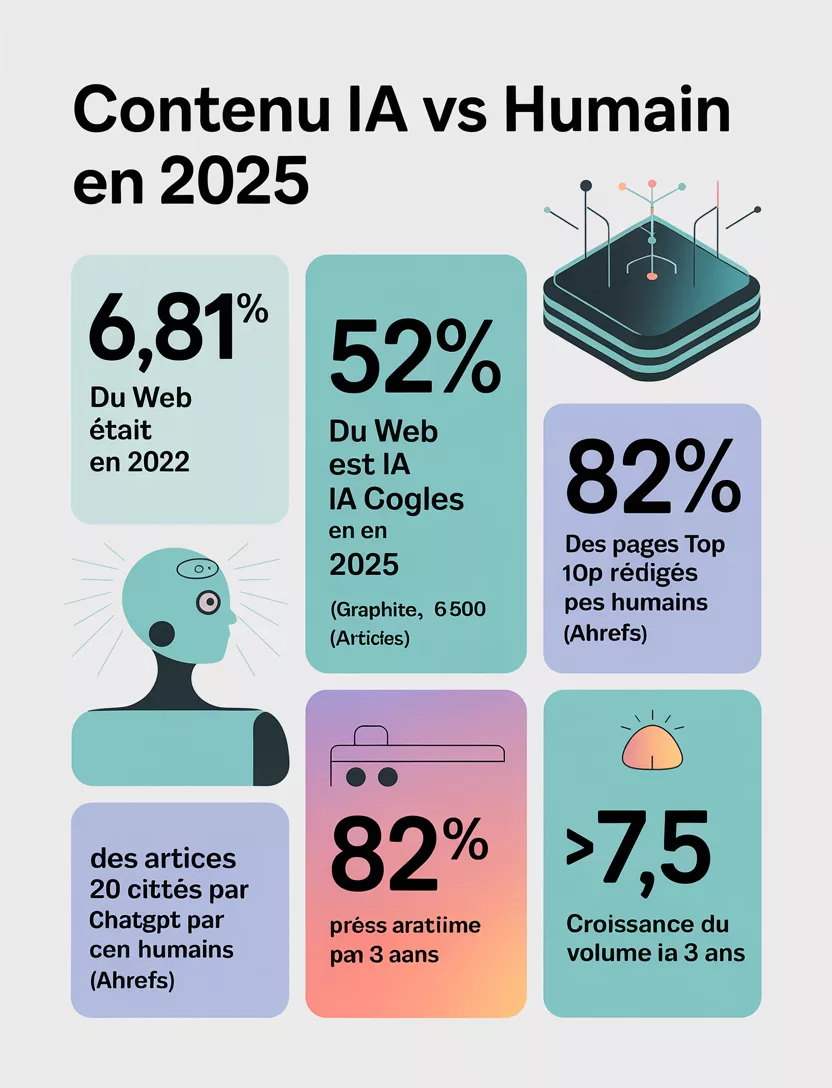

En octobre 2025, la société d’analyse SEO Graphite a publié les résultats d’une étude portant sur 65 000 articles : 52% du contenu web écrit est désormais généré par IA, contre 6,81% en 2022. Trois ans de croissance exponentielle pour un résultat contre-intuitif : ce n’est pas la qualité technique qui fait fuir les lecteurs, c’est la saturation. Quand la moitié du web dit la même chose avec les mêmes mots, le seuil d’exigence des audiences monte. Ce qui était acceptable en 2022 est aujourd’hui perçu comme du bruit.

52% du web est IA : pourquoi le vrai problème est la saturation ?

Les lecteurs ne détectent pas l’IA parce qu’ils sont experts en linguistique computationnelle. Ils la détectent parce qu’ils ont déjà lu cet article, trois fois, sur trois sites différents, avec trois titres légèrement différents. La saturation crée une mémoire de schéma : le cerveau reconnaît la structure prévisible avant même d’avoir fini le premier paragraphe.

La donnée Graphite éclaire ce mécanisme : le volume de contenu généré par IA a été multiplié par 7,5 en trois ans. Pendant ce temps, selon une analyse Ahrefs publiée en juillet 2025, 86% des pages positionnées dans le top 20 de Google restent rédigées par des humains. Et plus révélateur encore : 82% des articles cités par ChatGPT et Perplexity dans leurs réponses sont d’origine humaine. Les moteurs génératifs construits sur l’IA préfèrent citer du contenu humain. Ce chiffre est le proxy le plus honnête de ce que les audiences valorisent réellement.

La saturation a un effet secondaire souvent ignoré : elle élève mécaniquement le seuil d’attention. Un lecteur exposé quotidiennement à du contenu IA générique développe une résistance rapide aux introductions génériques, aux listes de cinq points, aux conclusions « l’avenir appartient à ceux qui s’adaptent ». Ce n’est pas de la suspicion, c’est de l’usure.

Les 5 signaux qui trahissent un contenu sans point de vue

L’article source de Webmarketing-com identifie cinq marqueurs comportementaux que les audiences repèrent, souvent inconsciemment. Ils ne sont pas liés à la grammaire ou à la cohérence factuelle. Ils sont liés à l’absence de position éditoriale.

Le premier est le ton neutre et consensuel : un texte qui ne prend jamais parti, ne surprend jamais, ne dérange jamais. Signal fort d’un contenu optimisé pour ne pas être faux plutôt que pour être utile. Vient ensuite l’absence de tension : les meilleurs contenus créent une friction. Ils disent « voici pourquoi la pratique courante est fausse ». L’IA, par construction, tend vers le consensus.

La structure trop prévisible en est un troisième signe. Introduction, définition, liste, conclusion. Le lecteur qui a déjà vu ce schéma cent fois accélère ou quitte. Le manque d’exemples vécus aggrave le problème : les exemples IA sont génériques par nature (« une entreprise du secteur retail », « un marketeur qui souhaitait augmenter ses conversions »). Ils ne résistent pas à la question « est-ce que ça s’est vraiment passé comme ça ? » Enfin, le vocabulaire de remplissage : « dans le contexte actuel », « il convient de noter que », « les enjeux sont multiples ». Chaque phrase de remplissage est une permission que le lecteur se donne de partir.

L’étude de Northwestern University nuance cependant le tableau : les lecteurs distinguent le contenu IA du contenu humain avec seulement 3% de différence sur la perception de qualité brute à la première lecture. La détection est donc moins consciente qu’on ne le pense. Elle se manifeste davantage dans le comportement (taux de rebond, non-partage, non-retour) que dans le jugement explicite.

Ce que les moteurs génératifs préfèrent (et que l’IA ne se génère pas)

La donnée la plus décisive pour comprendre les attentes des audiences en 2025 n’est pas une étude sur les lecteurs humains. C’est le comportement des moteurs génératifs. ChatGPT, Perplexity et Gemini citent en priorité des sources humaines (82% selon Ahrefs) parce que leurs algorithmes de sélection valorisent l’EEAT (Expérience, Expertise, Autorité, Fiabilité), les quatre critères de qualité de Google qui, par définition, ne peuvent pas être auto-certifiés par une IA.

« Google ne pénalise pas le contenu IA. Il favorise le contenu qui prouve une expérience réelle, une expertise vérifiable et une autorité construite dans le temps. » (Analyse Google Search Central, 2024)

L’IA peut produire du contenu techniquement conforme aux critères EEAT mais elle ne peut pas prouver qu’elle les satisfait. Un auteur humain avec un nom, un historique, des prises de position publiées et des données propriétaires prouve son EEAT par son existence. Une entité IA ne le peut pas. C’est cette asymétrie de preuve, et non une différence de qualité rédactionnelle, qui explique pourquoi les audiences et les algorithmes convergent vers le même choix.

Selon l’étude Brandwatch citée par Webmarketing-com, seuls 25% des marketeurs comprennent réellement leurs audiences et 46% peinent à transformer les données en insights actionnables. Ce chiffre révèle où se joue la compétition éditoriale : pas dans la production de contenu mais dans la capacité à convertir une connaissance terrain en point de vue unique.

Les actifs éditoriaux que l’IA ne peut pas répliquer

Face à la saturation, certains types de capital éditorial résistent à la banalisation par l’IA. Ils ne sont pas réservés aux grands médias. Ils sont accessibles à toute organisation qui accepte de penser son contenu comme un actif de différenciation plutôt qu’un volume à produire.

Les données propriétaires sont le premier. Un retour d’expérience avec des chiffres réels, une analyse de vos propres données CRM, un benchmark interne que personne d’autre ne peut reproduire. L’IA peut commenter des données publiques mais ne peut pas générer les vôtres. Un article qui dit « sur 1 200 campagnes que nous avons analysées, 34% des taux d’ouverture chutent après le troisième envoi consécutif la même semaine » ne peut pas être écrit par une IA sans vous.

La prise de position assumée est le deuxième. Dire que la pratique majoritaire du secteur est sous-optimale, que telle tendance est surestimée, que tel outil dominant a des angles morts. L’IA consensuelle ne prend pas de risques éditoriaux. Or ce sont ces risques qui créent la mémorabilité et le partage.

L’expérience vécue et nommée complète le tableau. Un exemple avec un nom, une date, un contexte spécifique. Pas « une entreprise e-commerce qui a augmenté son taux de conversion » mais « en mars 2024, cette boutique de cosmétiques belge a divisé par deux son taux d’abandon panier en supprimant son pop-up de bienvenue ». La précision est la signature du vécu.

La question à poser avant de publier

La question n’est plus « ce contenu est-il bien rédigé ? » mais « ce contenu apporte-t-il quelque chose qu’aucun autre résultat Google ne donne ? » C’est le critère d’information gain, le gain informationnel mesurable pour le lecteur, que les algorithmes de Google et les moteurs génératifs évaluent de plus en plus finement. Un contenu qui répond à une requête sans apporter de donnée, d’angle ou de nuance nouveaux est invisible non parce qu’il est mauvais mais parce qu’il est redondant.

Avant de publier, trois questions suffisent : Cet article contient-il au moins une information qu’on ne trouve pas dans les 10 premiers résultats Google sur ce sujet ? Y a-t-il au moins une prise de position que l’auteur assume et que l’IA n’aurait pas générée d’elle-même ? Y a-t-il au moins un exemple ou une donnée propriétaire qui ne peut provenir que d’une expérience réelle ?

Si la réponse est non aux trois questions, l’article rejoindra les 52% de contenu web que les lecteurs ont appris à ignorer avant même d’avoir fini de le lire.