Le secteur de l’intelligence artificielle vient d’être marqué par une double annonce majeure : OpenAI dévoile son modèle avancé de conversion parole à parole, baptisé GPT-Realtime, tout en renforçant sa API temps réel avec des fonctionnalités destinées aux applications vocales professionnelles. Ces évolutions incluent la prise en charge du protocole MCP pour serveurs distants, l’intégration de la saisie d’image comme entrée et la compatibilité SIP pour les appels téléphoniques. L’arrivée de ces innovations souligne la volonté d’OpenAI de se positionner parmi les acteurs incontournables de la synthèse vocale automatisée et du traitement de la voix.

Les avancées techniques du modèle GPT-Realtime

GPT-Realtime représente une évolution significative par rapport aux approches traditionnelles de traitement vocal. Contrairement aux générations précédentes, ce modèle vise une communication vocale plus naturelle, avec des réponses fluides et expressives, parfois difficiles à distinguer de celles d’un interlocuteur humain. Les messages vocaux bénéficient d’améliorations sur plusieurs plans : capture subtile de l’intonation, gestion dynamique du rythme, et adaptation contextuelle, y compris lors des échanges multilingues ou dans le cadre de dialogues avec changement de ton ou d’émotions.

La conception modulaire du modèle a permis d’accroître les capacités de reconnaissance et de synthèse en temps réel. Ces performances s’appuient sur des architectures neuves, capables de traiter rapidement les flux audio entrants et sortants, même lors d’échanges complexes impliquant l’analyse du raisonnement sous-jacent au discours. Cette robustesse ouvre aussi la porte à une utilisation industrielle intensive, où la fiabilité et la rapidité sont primordiales.

Quels bénéfices concrets face aux anciennes solutions ?

Les benchmarks montrent que GPT-Realtime dépasse les anciens modèles sur trois points essentiels : vitesse de traitement, qualité perçue de la voix générée et capacité à suivre des conversations naturelles, c’est-à-dire proches de nos interactions quotidiennes. Cela signifie non seulement une réduction du délai entre la réception d’un message et la réponse générée, mais aussi une distinction moindre entre voix humaine et synthétique.

Un autre avantage provient de la gestion polyglotte améliorée, qui permet le passage sans discontinuité d’une langue à l’autre. GPT-Realtime reconnaît également mieux les nuances expressives : rires, hésitations ou changements d’humeur sont analysés puis reproduits par la machine.

Où situer GPT-Realtime sur le marché de la voix IA ?

Sur un marché désormais concurrentiel avec l’arrivée de nombreuses plateformes vocales, GPT-Realtime met l’accent sur sa polyvalence et sur l’utilisation intensive en production, de la relation client automatisée au support multicanal. L’ajout simultané de fonctions API clés contribue à renforcer cet ancrage dans l’écosystème professionnel.

Comparé à ses concurrents directs, GPT-Realtime présente un avantage certain en termes de flexibilité (notamment grâce à la détection automatique du contexte de conversation et la gestion des situations ambiguës). Son intégration simplifiée dans des infrastructures variées favorise également une adoption large chez les développeurs orientés services vocaux.

Présentation détaillée des nouvelles capacités de l’API temps réel

L’évolution de l’API temps réel d’OpenAI ne se limite pas à l’amélioration des performances vocales. Cette mise à jour introduit une palette d’options inédites pour les développeurs, afin d’intégrer davantage d’éléments multimodaux et protocolaires dans leurs applications. Les annonces du mois d’août 2025 révèlent de nouveaux axes d’intégration, particulièrement pertinents dans les contextes industriels ou mobiles.

La compatibilité étendue avec différents serveurs et canaux élargit le périmètre d’applicabilité de l’API, rendant possibles des scénarios de communications complexes jusque-là difficiles à mettre en œuvre avec d’autres outils.

Qu’apporte le support serveur MCP et le mode image input ?

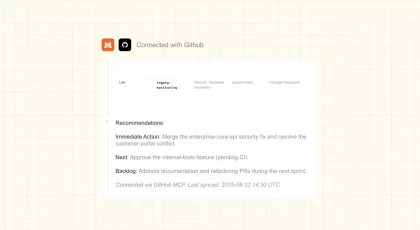

L’intégration du protocole Model Context Protocol (MCP) autorise la connexion à des serveurs distants spécialisés, souvent utilisés dans le secteur de la relation client automatisée ou les agents vocaux intelligents de nouvelle génération. Cette extension facilite le stockage et le partage efficace du contexte conversationnel, réduisant les risques de pertes d’information lors des transitions entre sessions ou dispositifs.

Parallèlement, la saisie d’images (image input) constitue une véritable nouveauté. Elle confère à l’API la capacité d’extraire et d’interpréter en temps réel des informations visuelles soumises par l’utilisateur. Cela ouvre des usages interactifs, par exemple lors d’un échange où l’interlocuteur souhaite faire analyser une photo pour enrichir la conversation ou obtenir un conseil ciblé.

Comment l’API facilite-t-elle les appels via SIP ?

Autre avancée notable : la compatibilité avec le Session Initiation Protocol (SIP). Ce protocole standardise l’établissement, la gestion et la terminaison des communications vocales et vidéo sur réseaux IP. Grâce à cette prise en charge, l’API ouvre la voie à l’automatisation ou à l’enrichissement d’appels téléphoniques professionnels depuis une solution cloud, qu’il s’agisse de contacts internes, de centres d’appels ou de plateformes de télémarketing.

En combinant synchronisation instantanée, contextualisation rapide du dialogue et transcription accélérée, ces nouvelles possibilités apportent des gains de productivité notables pour tous les secteurs exploitant la voix.

| ⚙️ Fonction | ✅ Nouvelle version | ⏳ Anciennes versions |

|---|---|---|

| Traitement vocal temps réel | Ultra-rapide ⚡ | Sous-seconde |

| Qualité expressive de la voix | Haute fidélité 🎤 | Légère robotisation |

| Input visuel | Support images 🖼️ | Non disponible |

| MCP serveur distant | Compatibilité élargie 🚀 | Limité/local |

| Gestion d’appels SIP | Plein support 📞 | Absent |

| Changement de langue natif | Sans coupure 🌐 | Transitions moins fluides |

Perspectives d’adoption et implications pour les applications vocales

L’arrivée de GPT-Realtime et des nouvelles extensions API accentue l’intégration progressive de la voix IA dans nos environnements professionnels et grand public. Les interfaces automatisées gagnent ainsi en crédibilité, avec des réponses plus humaines, un accès facilité à l’image comme donnée d’enrichissement et la possibilité d’assurer un cycle complet d’appel téléphonique géré par intelligence artificielle.

Face à la multiplication des cas d’usage – centre d’assistance, éducation, commerce connecté – ces outils influencent durablement la manière dont les utilisateurs interagissent avec la technologie. Le soutien aux processus métier complexes devient accessible à des structures variées, du démarrage d’un projet pilote à l’exploitation globale à grande échelle.

Que retenir pour les développeurs et entreprises ?

Ces nouveautés s’accompagnent d’une documentation technique étoffée, ainsi que d’outils de test destinés à réduire la barrière à l’entrée pour l’expérimentation rapide. Les retours initiaux pointent vers des délais de latence réduits, une stabilité accrue lors des pics de trafic et une intégration adaptable à l’existant informatique des entreprises.

Dans une logique de conformité, OpenAI mentionne également la prise en compte des contraintes de sécurité et de confidentialité nécessaires à une adoption dans des secteurs régulés, tels que la santé ou les services financiers.